Com a chegada da inteligência artificial às redações, o jornalismo enfrenta novos dilemas éticos, automatiza rotinas e redescobre papel do repórter humano na era digital

Kamila Macedo (@kamzmacedo) e Larissa Lima (@163lima)

ChatGPT. Alexa. Gemini. Siri. Waze. Copilot. Você com certeza já interagiu com alguma Inteligência Artificial (IA), mesmo que não saiba disso. No mundo atual, na era digital, a IA está presente no cotidiano humano assim como a água está no habitat dos animais marinhos e o sol na vida dos seres terrestres. O que pode ser um exemplo um tanto hiperbólico, também reflete em uma realidade concreta. Atividades como conversar com assistentes virtuais para marcação de consultas em clínicas e hospitais, receber uma recomendação daquele item que você queria tanto comprar e, até mesmo, o reconhecimento facial para desbloquear o acesso ao seu celular. Todas essas interações são exercidas pelas IAs.

E, apesar da inteligência artificial ter começado a ser estudada em meados de 1950, com John McCarthy, os anos que compreendem a década de 2020 estão sendo marcados com uma vertente específica: a tendência dos últimos anos é a chamada “Inteligência Artificial Generativa”.

A Inteligência Artificial Generativa (IAG) é um subcampo em que algoritmos simulam os processos de aprendizado e a tomada de decisões do cérebro humano. A IAG usa informações retiradas a partir de grande quantidade de dados, para compreender solicitações e perguntas de linguagem natural, usada pelos humanos para se comunicarem, para responder com um conteúdo novo e relevante ao usuário. Em resumo, é o subcampo com foco na criação de novos conteúdos como texto, imagens, áudio e vídeo, em que os sistemas computacionais aprendem e melhoram suas capacidades de linguagem com base em dados e experiências existentes produzidos pelos humanos.

A inteligência artificial é um sistema que aprende a partir de muitos exemplos para conseguir realizar tarefas. Teresa Ludermir explica que a IAG faz previsões e compara os resultados com as respostas corretas, ajustando seus produtos internos para sempre melhorar, processo que se chama de aprendizado de máquina (Machine Learning). Depois de treinada, a IA é capaz de usar o que aprendeu para resolver novos problemas ou responder a perguntas sobre coisas que ela nunca viu antes. Isso é chamado de generalização.

Nos últimos anos, essa tecnologia tem reconfigurado a dinâmica comunicacional, inclusive no jornalismo. Mesmo que a IA não seja tão recente, sua implementação como parte do dia-a-dia ainda está em processo, em especial a IAG. No período atual, a utilização tem crescido muito no sentido de otimização de tempo e de trabalho, como para revisões textuais, montagens de planilhas e infográficos, além de produções de textos padronizados (como e-mails), checagens de fontes ou até ideias para pautas.

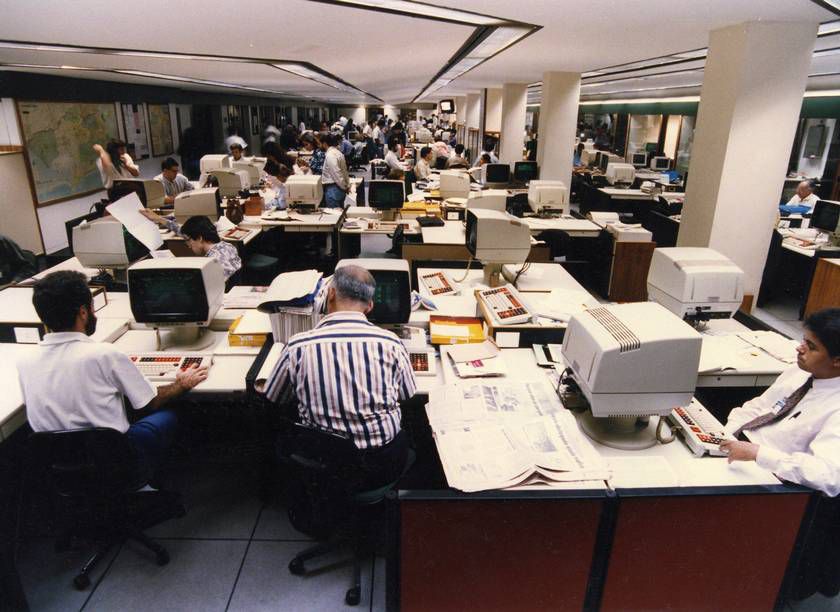

Incorporação da IAG pelas redações

“O uso mais transformador da IA está na colaboração, como copiloto de ideias, como ferramenta para aprofundar investigações ou otimizar tarefas repetitivas. Não é sobre substituir, mas sobre ampliar o repertório do jornalista”. Quem afirma é o jornalista Ben-Hur Correia, repórter da TV Globo, pesquisador e doutorando do Centro de Estratégia e Inovação da Universidade Federal do Rio de Janeiro (UFRJ), com foco na adoção de ferramentas de inteligência artificial nos negócios.

Ben-Hur conta que adotou a IAG em sua rotina, indo desde pequenas tarefas, como transcrição de entrevistas e sugestão de ângulos para a pauta, até a organização de bases de dados complexas para investigações. “Em projetos especiais, uso IA para cruzamento de dados públicos, análise de discurso em redes e até na prototipagem de narrativas audiovisuais. O mais importante, pra mim, é sempre manter o controle editorial e saber onde a IA está ajudando”.

“O desafio não é resistir à IA, mas revalorizar o que só o humano pode oferecer: apuração in loco, sensibilidade, escuta, crítica e criatividade”, destaca o jornalista.

Editor-chefe do Bahia Notícias (BN), site de notícias fundado em 2006, o jornalista Fernando Duarte explica que existe uma instrução para a equipe do BN em relação ao uso da inteligência artificial nas produções do portal baiano. “Utilizamos ferramentas de IA para revisão de textos e para geração de títulos mais adaptados para ferramentas de buscas em geral. Há uma instrução para a equipe nesse sentido. Há também o uso de plataformas como Pinpoint e NotebookLM, ambas do Google, que permitem o processamento de um volume grande de dados, facilitando o acesso a informações que podem não estar na superfície em algumas matérias”, declara.

Também existem profissionais que preferem um uso mais comedido. Laiane Apresentação, estagiária de jornalismo, afirma sentir-se mais confortável ao usar a IAG apenas na última etapa da construção dos seus conteúdos. Apresentação explica que, quando faz o uso, opta pelo Gemini [IA assistente do Google] para sugestão de novos títulos e o Marfeel beta [plataforma de tecnologia de anúncios e inteligência de conteúdo] para sugestão de melhorias no texto. “Sinto que o Marfeel melhora a qualidade da matéria por sugerir coisas referentes ao SEO (Sigla para Search Engine Optimization, ou Otimização para Mecanismos de Busca em português, refere-se a estratégias utilizadas para potencializar a visibilidade de um site em buscas), ou à própria aparência do conteúdo. Na correria, às vezes não temos tempo de reler várias vezes o texto para pensar nas melhorias, então a ferramenta ajuda”, complementa.

Sendo um portal que declara ter como missão investigar, analisar e noticiar sobre o impacto da tecnologia digital na vida das pessoas, o Núcleo Jornalismo, criado em janeiro de 2020, foi o primeiro portal jornalístico a compartilhar as políticas de uso da IA na redação, logo no ano seguinte ao lançamento do ChatGPT da OpenAI, em 2023. Entre as utilidades que eles alegam, percebemos o uso para pesquisa por assuntos e temas, a transcrição de áudios e vídeos para formato de textos, sugestão de posts, construção de sumários e melhora de textos – aplicações que continuam presentes em 2025 apesar das novas possibilidades. O Grupo Globo, o Estado de S. Paulo e a Folha de S. Paulo também possuem princípios para uso de IA por suas redações.

Existem algumas camadas na integração da inteligência artificial com o jornalismo. Há ferramentas de automação, coleta e análise de dados, assim como as ferramentas partidas da IAG que com a coleta de dados e seguindo comandos produz informações novas. Além do uso na construção dos conteúdos, os sistemas também foram e têm sido empregados na distribuição do conteúdo.

Mapeamos através das entrevistas e da análise dos guias jornalísticos do Farol Jornalismo e da Associação de Jornalismo Digital (Ajor), que a ferramenta se torna proveitosa ao personalizar o conteúdo, otimizando-o para os diferentes canais de distribuição, ao analisar o impacto, por exemplo, através do monitoramento de redes sociais. A produção visual também é outra forma de adequar a distribuição, assim como disponibilizar os textos em áudio, tornando acessível com audiovisuais fazendo dos dados mais compreensíveis, eles destacam ferramentas como Echobox e SocialFlow para isso.

Os desafios que atravessam o jornalismo

Com o lançamento do ChatGPT, em novembro de 2022 pela OpenAI, o mundo passou a enxergar uma nova forma de trabalhar. Como dito, atividades como análise de dados, geração de textos e correção ortográfica tornaram-se automatizadas com o uso da nova tecnologia. Isso desencadeou uma verdadeira corrida entre as grandes empresas de tecnologia, as chamadas Big Techs, para desenvolver novas inteligências artificiais generativas, a maioria baseada em código fechado.

A questão surge: qual é a diferença entre código fechado e código aberto? Essa divisão gera debates entre os desenvolvedores dessas plataformas sobre qual seria a melhor opção a ser adotada. Enquanto o Google com o Gemini, e a OpenAI em parceria com a Microsoft, com o próprio ChatGPT, apostam em um código fechado, a Meta com o LLaMA e a DeepSeek utilizam código aberto em seus processos. No modelo de código fechado, o acesso ao código-fonte é restrito aos desenvolvedores da plataforma, o que pode limitar a transparência e impedir que pesquisadores, profissionais da comunicação e desenvolvedores independentes compreendam ou modifiquem o funcionamento desses sistemas. Em contraste, tecnologias de código aberto, também chamadas de open source, permitem o acesso público ao código-fonte, estimulando a inovação colaborativa, a adaptação local e maior autonomia no uso da ferramenta.

Muitas implicações relacionadas ao uso da inteligência artificial no jornalismo dizem respeito aos impactos éticos e de confiança. Por isso, a discussão recente favorece a utilização da IA como um instrumento que deve ser observado e revisado por humanos. Uma pesquisa feita pelo Reuters Institute of Journalism, com 45 usuários de notícias digitais no México, Reino Unido e EUA em 2024, afirma que apenas 36% dos usuários sentem-se confortáveis consumindo notícias produzidas por humanos com a ajuda de IA e menos ainda (19%) sentem-se confortáveis usando notícias produzidas principalmente por IA com supervisão humana. Também foi observado pela Reuters que pessoas com maior conhecimento sobre IA tendem a se sentir relativamente mais confortáveis com o uso de IA no jornalismo.

Para Moisés Costa Pinto, pesquisador do GJOL, doutorando em Comunicação e Cultura Contemporâneas (Póscom | UFBA) e professor na Unijorge, a dificuldade de admissão do uso vem também da falta de entendimento da potencialidade do recurso. “Então, temos hoje uma dificuldade de admitir isso, mas também é por uma falta de compreensão das potencialidades. E é das potencialidades e limitações. Se tem essa noção de que a IA pode tudo e a gente não compreende que ela é limitada e que por isso ela não vai fazer nada sozinha. Mas se pode admitir que utiliza IA”, explica.

No Brasil, observa-se um uso crescente dessas ferramentas estrangeiras, o que acaba por limitar, entre outros aspectos, a inovação no jornalismo nacional no que diz respeito à criação de tecnologias de ponta. Uma preocupação se manifesta nesse cenário: a dependência do jornalismo brasileiro no uso dessas tecnologias internacionais. “As IAs generativas que utilizamos hoje vêm todas de fora. Não há, por aqui, um projeto consistente de automação ou de busca por independência das plataformas”, afirma o professor Moisés.

As informações passam a ser restritas e a apuração, uma das bases fundamentais do jornalismo, se torna comprometida ao depender exclusivamente dessas plataformas. Quando todos utilizam a mesma IA, treinada para buscar dados de maneira semelhante na internet, os resultados tendem a se repetir, mesmo que provenientes de fontes distintas, o que gera repetição e compromete a originalidade. “Se todo mundo tem acesso às mesmas IAs e essas IAs funcionam de forma semelhante, como no caso da sumarização de conteúdo com o ChatGPT ou outras ferramentas, no fim das contas, os resultados também serão muito parecidos. O conteúdo tende a ficar planificado”.

Outro problema observado é a alucinação, termo utilizado quando essas tecnologias se “confundem” e acabam cometendo erros ao não compreenderem corretamente as informações. Isso ocorre por algumas razões: dados de treinamentos insuficientes, utilização de referências falsas nos treinamentos ou suposições da própria IA, como explica uma matéria do The Conversation.

Essas questões comprometem a utilização exclusiva da inteligência artificial nos processos jornalísticos, em especial na credibilidade do conteúdo como base para apuração.

Sobre os limites éticos, o que está sendo feito?

A transparência, qualidade intrínseca ao jornalismo, se mantém em evidência quando falamos sobre os limites éticos enfrentados pela categoria nesta adaptação comunicacional. Fernando Duarte destaca que esse pode ser o grande dilema no uso junto com o esforço de manter a confiabilidade e a credibilidade do conteúdo. “Especialmente quando ferramentas de detecção de IA consideram que textos produzidos por humanos foram construídos a partir de ferramentas generativas”, diz.

Duarte complementa que o fator humano vai continuar sendo relevante. No entanto, afirma considerar improvável para o jornalismo manter a inércia nesse processo de evolução, especialmente porque qualquer atraso na adaptação à tecnologia, tanto os profissionais quanto às empresas, para ele significa que ficarão paradas no tempo.

“Eu considero a IA como aliada, desde que o uso seja adequado e com a devida informação ao público”, afirma Duarte.

A Agência Pública afirma nas suas políticas que “como princípio, vemos a IA como uma ferramenta de apoio ao trabalho jornalístico que jamais irá substituir jornalistas, programadores, ilustradores, narradores ou designers. Nossa política de uso vem da consolidação de discussões internas e reúne diretrizes e princípios que vamos adotar quanto ao uso de IA”.

Nesse cenário apresentado, com implicações éticas sendo debatidas, surge a proposta de regulamentação do uso da IA. De acordo com a Agência Câmara de Notícias, o Projeto de Lei 2338/2023, conhecido também como PL da Inteligência Artificial, prevê a classificação desses sistemas em níveis de risco tanto para a vida humana, como aos direitos fundamentais.

No entanto, essa proposta pode não abarcar a complexidade da área da comunicação, como esclarece Ben-Hur Correia: “Tende a focar mais nos aspectos técnicos e industriais da IA, deixando de lado questões centrais para a mídia, como a transparência algorítmica, o uso de IA em publicidade política, e a responsabilização por desinformação automatizada. O jornalismo precisa estar à mesa da regulação não como objeto, mas como sujeito que participa da construção de uma IA pública, plural e ética”.

Assuntos como direitos autorais – tanto em imagens, quanto em textos e áudios –, utilização desenfreada sem nenhum aviso por parte do veículo, segurança em relação à manipulação de conteúdos sensíveis e criminosos, são alguns dos principais debates incluídos no PL.

Plano para criar uma IA brasileira

Que movimentos estão acontecendo no país para acompanhar os avanços da IA? Foi proposto um desafio à comunidade de estudiosos no Brasil durante a 5ª Conferência Nacional de Ciência, Tecnologia e Inovação (CNTI), que ocorreu entre 30 de julho a 1º de agosto de 2024, no Distrito Federal, em Brasília. A proposta consistia em desenvolver uma plataforma de inteligência artificial em português e transformar o país em referência mundial em tecnologia e inovação.

Encomendado pelo presidente Luiz Inácio Lula da Silva, o plano foi lançado oficialmente como o Plano Brasileiro de Inteligência Artificial (PBIA) 2024-2028. Há um investimento previsto de R$23 bilhões, que será diluído entre os quatro anos de atuação do projeto. Assim, tecnologias brasileiras baseadas em inteligência artificial poderão alcançar maior visibilidade e reconhecimento no mercado – o que pode também ser uma possível solução para a questão debatida por Moisés Costa Pinto a respeito da dependência das tecnologias estrangeiras.

Com isso, o que se espera do jornalismo no futuro?

Com todos esses desafios, adaptações de rotina nas redações, dilemas éticos do uso correto da IA, a angústia sobre o que esperar com a atuação dessas novas tecnologias é grande. Os três profissionais entrevistados expressaram suas opiniões acerca do futuro do jornalismo:

Para Ben-Hur Correia, essa nova etapa exige que os jornalistas assumam o protagonismo no uso das tecnologias, explorando seu potencial para personalizar conteúdos, ampliar coberturas locais e aprofundar análises: “O futuro do jornalismo com IA não é automatizado, é co-inteligente. É quando humanos e máquinas colaboram, cada um com seus limites e potências, para produzir algo mais significativo para a sociedade”.

“O fator humano vai continuar sendo relevante, ainda que as IAs estejam cada vez melhor treinadas. O jornalismo terá que se adaptar para não ser integralmente suplantado”, afirma Fernando Duarte, destacando que, atualmente, a IA está sendo usada para atividades mais mecanizadas.

“Jornalista que não se atualiza, não anda para frente; anda para o lado, como caranguejo”, ressalta Moisés Costa Pinto. “Não podemos substituir todos os jornalistas por máquinas. Nós precisamos dos humanos, porque só os humanos se comunicam tão bem com outros humanos. O jornalista ‘robô’ ajuda, mas nada substitui o jornalista humano”.

No fim, o trabalho do jornalista é mais humanizado que apenas o texto automático gerado por uma máquina. Existe a sensibilidade, a empatia, a atenção na apuração dos fatos e a personalidade ao transcrever as informações para as páginas de um jornal – ou de qualquer que seja o formato, mídia ou veículo trabalhado.

_________________________________________________________________________

Kamila Macedo é estudante de Jornalismo da Universidade Federal da Bahia (UFBA) e atualmente é estagiária de comunicação no Programa Acelera da Fundação José Silveira.

Larissa Lima é uma jornalista em formação na Faculdade de Comunicação (FACOM |UFBA), voluntária na Agência de Notícias Ciência e Cultura da Unidade e estagiária do Projeto Conectar Cultural. Tem interesse em temas relacionados a ciência, tecnologia e cultura.

O interesse por essa pauta surgiu do desejo de compreender como o jornalismo vem se adaptando às mudanças em suas rotinas com a introdução da inteligência artificial, algo que atravessa diretamente o nosso dia a dia como estudantes. O foco está em entender como os profissionais da área têm refletido sobre o uso da inteligência artificial na produção, disseminação e controle do conteúdo jornalístico, considerando também o interesse público e os limites éticos envolvidos.

¹ Imagem destacada gerada por inteligência artificial (ChatGPT)